Übersicht

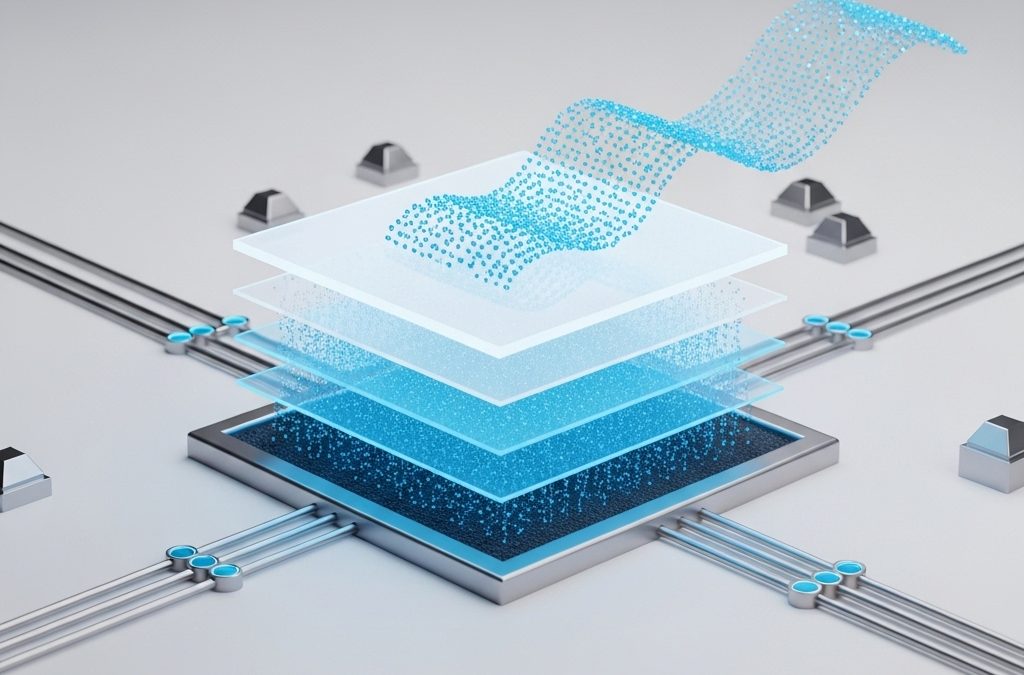

Da KI-Agenten immer ausgefeilter und stärker in unser digitales Leben integriert werden, wächst die Notwendigkeit robuster Sicherheitsmaßnahmen. Eine erhebliche Herausforderung in dieser sich entwickelnden Landschaft ist die ‘Prompt Injection’, eine Angriffsform, bei der bösartige Eingaben das Verhalten einer KI manipulieren oder sensible Informationen extrahieren. OpenAIs Ansatz zur Stärkung von Systemen wie ChatGPT gegen solche Schwachstellen wurzelt in grundlegenden Designprinzipien. Anstatt sich ausschließlich auf externe Filter zu verlassen, sind die Abwehrmechanismen direkt in den Workflow des Agenten integriert. Dies beinhaltet die systematische Einschränkung der Fähigkeit der KI, riskante Aktionen auszuführen, und die Implementierung strenger Protokolle zum Schutz sensibler Daten. Indem sie von Natur aus begrenzen, was eine KI tun und auf welche Informationen sie zugreifen kann, sind diese Systeme so konzipiert, dass sie ihre beabsichtigte Funktionalität beibehalten und die Benutzersicherheit gewährleisten, selbst wenn sie mit irreführenden Prompts konfrontiert werden. Dieser proaktive, architektonische Ansatz ist entscheidend für den Aufbau von Vertrauen und Zuverlässigkeit in fortschrittlichen KI-Anwendungen.

Auswirkungen auf die KI-Landschaft

Die Fähigkeit von KI-Agenten, Prompt Injection und Social Engineering effektiv zu widerstehen, hat tiefgreifende Auswirkungen auf die gesamte KI-Landschaft. Sie stellt einen entscheidenden Schritt zur Bereitstellung autonomerer und vertrauenswürdigerer KI-Systeme in verschiedenen Sektoren dar, vom Kundenservice bis zur komplexen Datenanalyse. Wenn KI-Agenten von Natur aus manipulationsresistent sind, können Unternehmen sie bedenkenlos in sensible Operationen integrieren, da sie wissen, dass ihre Integrität gewahrt bleibt. Dies fördert Innovation, indem es Entwickler ermutigt, ehrgeizigere Anwendungen für KI zu erforschen, unbelastet von der ständigen Bedrohung durch bösartige Übernahmen. Darüber hinaus setzt es einen höheren Standard für KI-Sicherheit und verantwortungsvolle Entwicklung in der gesamten Branche. Da KI-Systeme leistungsfähiger werden und mit realen Systemen interagieren, ist die Sicherstellung, dass sie innerhalb definierter Grenzen arbeiten und Benutzerdaten schützen, nicht nur eine Funktion, sondern eine grundlegende Voraussetzung für ihre weite Verbreitung und ihren gesellschaftlichen Nutzen. Dieses proaktive Sicherheitsparadigma ist für die gesunde Entwicklung der KI unerlässlich.

Praktische Anwendung

In der Praxis manifestieren sich die Abwehrmechanismen gegen Prompt Injection auf verschiedene entscheidende Weisen innerhalb der Workflows von KI-Agenten. Zum Beispiel würde eine mit diesen Schutzmaßnahmen entwickelte KI daran gehindert, ihre internen System-Prompts preiszugeben, die sonst von Angreifern ausgenutzt werden könnten. Sie wäre auch daran gehindert, unautorisierte Befehle auszuführen, wie das Löschen von Dateien oder den Zugriff auf externe Systeme ohne explizite, sichere Berechtigungen. Der Schutz sensibler Daten bedeutet, dass selbst wenn ein Angreifer versucht, die KI dazu zu bringen, private Benutzerinformationen oder proprietäre Unternehmensdaten preiszugeben, die Architektur des Agenten verhindert, dass sie auf diese Informationen außerhalb ihrer sicheren Parameter zugreift oder sie teilt. Dies sind nicht nur Patches, sondern grundlegende architektonische Entscheidungen, die in die Betriebslogik der KI eingebettet sind. Durch die Implementierung strenger Zugriffskontrollen, Sandboxing-Fähigkeiten und klarer Grenzen für die Dateninteraktion können KI-Agenten komplexe Anfragen bearbeiten und gleichzeitig ihre Sicherheitsprotokolle strikt einhalten, was Benutzern und Entwicklern Sicherheit hinsichtlich der Robustheit und des ethischen Betriebs des Systems bietet.

Original source: View original article