Visión General

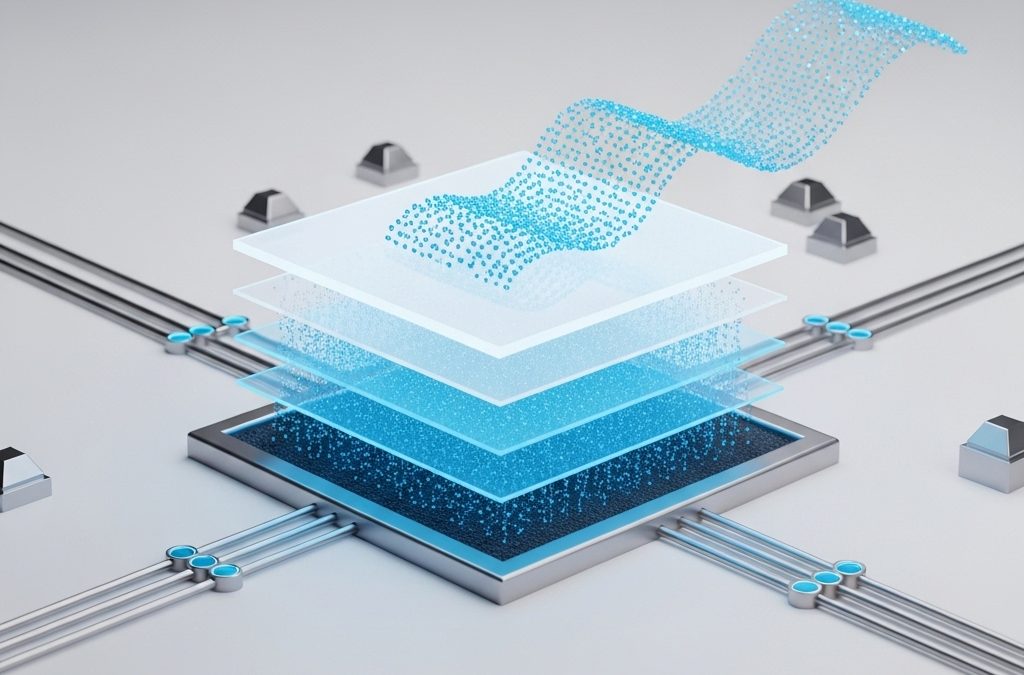

A medida que los agentes de IA se vuelven cada vez más sofisticados e integrados en nuestras vidas digitales, la necesidad de medidas de seguridad robustas crece. Un desafío significativo en este panorama en evolución es la ‘inyección de prompts’, una forma de ataque donde entradas maliciosas manipulan el comportamiento de una IA o extraen información sensible. El enfoque de OpenAI para fortificar sistemas como ChatGPT contra tales vulnerabilidades se basa en principios de diseño fundamentales. En lugar de depender únicamente de filtros externos, los mecanismos de defensa están tejidos directamente en el flujo de trabajo del agente. Esto implica restringir sistemáticamente la capacidad de la IA para ejecutar acciones riesgosas e implementar protocolos estrictos para proteger datos sensibles. Al limitar inherentemente lo que una IA puede hacer y a qué información puede acceder, incluso cuando se enfrenta a prompts engañosos, estos sistemas están diseñados para mantener su funcionalidad prevista y garantizar la seguridad del usuario. Este enfoque arquitectónico y proactivo es fundamental para construir confianza y fiabilidad en aplicaciones avanzadas de IA.

Impacto en el Panorama de la IA

La capacidad de los agentes de IA para resistir eficazmente la inyección de prompts y la ingeniería social tiene profundas implicaciones para el panorama general de la IA. Representa un paso crítico hacia el despliegue de sistemas de IA más autónomos y confiables en diversos sectores, desde el servicio al cliente hasta el análisis de datos complejos. Cuando los agentes de IA son inherentemente resistentes a la manipulación, las empresas pueden integrarlos con confianza en operaciones sensibles, sabiendo que su integridad se mantiene. Esto fomenta la innovación al alentar a los desarrolladores a explorar aplicaciones más ambiciosas para la IA, sin la carga de la amenaza constante de un secuestro malicioso. Además, establece un estándar más alto para la seguridad de la IA y el desarrollo responsable en toda la industria. A medida que los sistemas de IA se vuelven más potentes e interactúan con sistemas del mundo real, asegurar que operen dentro de límites definidos y protejan los datos del usuario no es solo una característica, sino un requisito fundamental para su adopción generalizada y beneficio social. Este paradigma de seguridad proactivo es esencial para la evolución saludable de la IA.

Aplicación Práctica

En términos prácticos, las defensas contra la inyección de prompts se manifiestan de varias maneras cruciales dentro de los flujos de trabajo de los agentes de IA. Por ejemplo, una IA diseñada con estas protecciones evitaría revelar sus prompts internos del sistema, que de otro modo podrían ser explotados por atacantes. También se le restringiría la ejecución de comandos no autorizados, como eliminar archivos o acceder a sistemas externos sin permisos explícitos y seguros. La protección de datos sensibles significa que, incluso si un atacante intenta engañar a la IA para que divulgue información privada del usuario o datos propietarios de la empresa, la arquitectura del agente le impide acceder o compartir esa información fuera de sus parámetros seguros. Estas no son meras soluciones temporales, sino decisiones arquitectónicas fundamentales incrustadas en la lógica operativa de la IA. Al implementar controles de acceso estrictos, capacidades de sandboxing y límites claros para la interacción de datos, los agentes de IA pueden navegar solicitudes complejas mientras se mantienen firmes en sus protocolos de seguridad, ofreciendo a usuarios y desarrolladores tranquilidad con respecto a la robustez y el funcionamiento ético del sistema.

Original source: View original article